آنتروپیک برای آموزش هوش مصنوعی از مکالمات کاربران منفعت گیری خواهد کرد_اسپایدر

[ad_1]

نوشته و ویرایش شده توسط تیم اسپایدر

آنتروپیک، سازنده مدل هوش مصنوعی محبوب کلود، در یک تحول سیاست بزرگ خبرداد که از این بعد از مکالمات و کدهای کاربران برای آموزش و بهبود مدلهای آینده خود منفعت گیری خواهد کرد، مگر این که کاربران به صراحت مخالفت خود را اظهار کنند.

آنتروپیک به تازگی سیاستهای خود را بهروز کرد تا از مکالمات کاربران برای آموزش مدلهای خود منفعت گیری کند. این چنین زمان زمان نگهداری دادههای کاربرانی که با این نوشته موافقت کنند، به پنج سال افزایش مییابد. این سیاست تازه نگرانیهای جدی درمورد حریم خصوصی و نحوه رضایت گرفتن از کاربران به وجود اورده است.

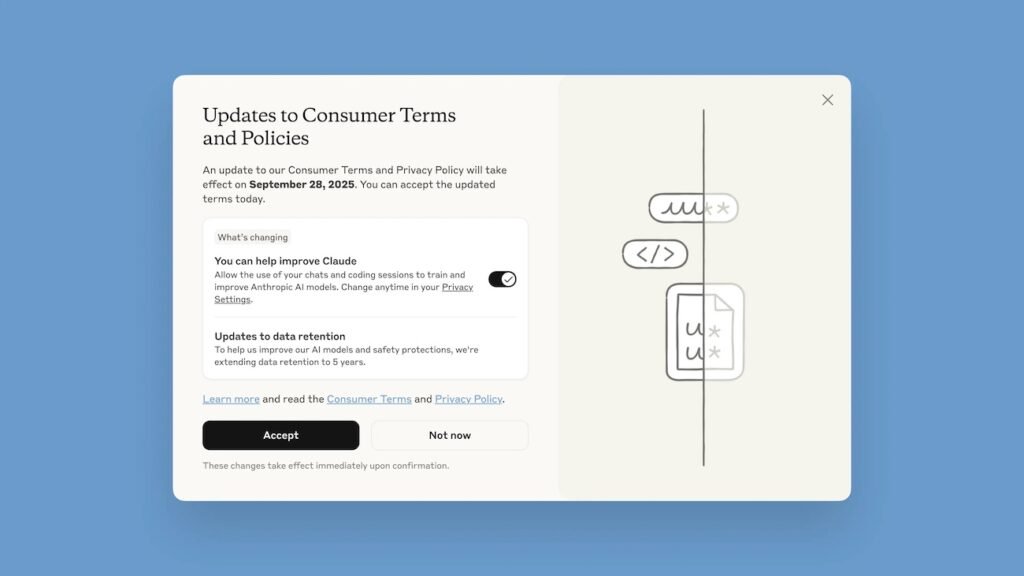

اکنون کاربران هنگامی داخل این چتبات خواهد شد، با یک پنجره پاپآپ با گفتن «بهروزرسانی شرایط و سیاستهای مصرفکننده» روبه رو خواهد شد که باید تا تاریخ ۲۸ سپتامبر ۲۰۲۵ (۶ مهر ۱۴۰۴) تصمیم خود را نهایی کنند. بااینحال، طراحی این پنجره انتقاداتی را برانگیخته است.

آموزش مدلهای هوش مصنوعی آنتروپیک با مکالمات کاربران

یک دکمه بزرگ و برجسته «پذیرفتن» (Accept) در پایین صفحه پاپآپ تازه قرار دارد، درحالیکه گزینه مهم مربوط به اجازه منفعت گیری از دادهها برای آموزش، با فونت کوچکتر و به طور یک دکمه روشن/خاموش در زیر آن قرار گرفته است. این دکمه به طور پیشفکر روی حالت «روشن» تنظیم شده است. این طراحی علتمیبشود تعداد بسیاری از کاربران بدون خواندن جزئیات، تنها با کلیک روی دکمه بزرگ «پذیرفتن» نادانسته با اشتراکگذاری دادههای خود موافقت کنند.

اگر به نادرست موافقت کردهاید، میتوانید با مراجعه به تنظیمات (Settings)، سپس قسمت حریم خصوصی (Privacy) و در نهایت تکه «Help improve Claude» این گزینه را غیرفعال کنید. یقیناً باید دقت داشت که این تحول فقط بر روی دادههای آینده اثرگذار است و دادههایی که قبلاً برای آموزش منفعت گیری شدهاند، قابل بازپسگیری نیستند.

این بهروزرسانی شامل همه کاربران اشتراکهای مصرفکننده کلود، از جمله پلنهای رایگان، پرو و مکس میبشود. بااینحال آنتروپیک پافشاری کرده است که این تغییرات شامل کاربران تجاری و سازمانی (همانند Claude for Work و Education) و این چنین کاربرانی که از طریق API شرکتهای دیگر همانند Amazon Bedrock و Google Cloud به کلود دسترسی دارند، نمیبشود.

با اهمیت ترین مسئله این است که این سیاست فقط بر روی مکالمات تازه یا مکالمات قدیمی که از سر گرفته خواهد شد، اعمال خواهد شد. مکالمات قبلی شما تا وقتی که آنها را ادامه ندهید، برای آموزش منفعت گیری نخواهند شد.

آنتروپیک اظهار کرده است که مقصد از این کار ساخت مدلهای هوش مصنوعی تواناتر و مفیدتر است. به حرف های این شرکت دادههای کاربران به بهبود ایمنی مدلها، تشخیص دقیقتر محتوای زیان اور و تحکیم تواناییهایی همانند کدنویسی و تحلیل پشتیبانی خواهد کرد.

این شرکت ضمانت داده است که از ترکیبی از ابزارها و فرایندهای خودکار برای فیلترکردن یا نهانکردن دادههای حساس منفعت گیری میکند و دادههای کاربران را به هیچ شخص ثالثی نمیفروشد. کاربرانی که با اشتراکگذاری دادههای خود موافقت نکنند، هم چنان تحت سیاست قبلی باقی میهمانند و دادههایشان بعد از ۳۰ روز حذف خواهد شد.

دسته بندی مطالب

[ad_2]