مدل زبانی تازه اپل میتواند با سرعتی خیرهکننده متون طویل تشکیل کند_اسپایدر

[ad_1]

نوشته و ویرایش شده توسط تیم اسپایدر

مدل زبانی تازه اپل با منفعتگیری از معماری پیشرفته قادر است متنهای بلند و پیچیده را با سرعتی بسیار و دقت بالا تشکیل کند. بر پایه گزارشها، تیم تحقیقاتی اپل یک مدل مبتنی بر Diffusion اراعه کرده است که میتواند متنها را تا ۱۲۸ برابر سریع تر از مدلهای شبیه تشکیل کند.

مدلهای زبانی بزرگ همانند ChatGPT از نوع Autoregressive می باشند؛ این مدلها متن را بهصورت توکن به توکن و پشت سر هم تشکیل میکنند و هر توکن را با در نظر گرفتن ورودی کاربر و همه توکنهای قبل میسازند.

مدل زبانی تازه اپل شدت زیاد بسیاری دارد

در روبه رو، مدلهای Diffusion چند توکن را همزمان تشکیل کرده و در چند مرحله اصلاح میکنند تا جواب نهایی شکل بگیرد. یکی از انواع پیشرفته این مدلها، Flow-matching است که مرحله های اصلاح چندگانه را کنار میگذارد و تلاش میکند نتیجه نهایی را در یک مرحله بهدست آورد.

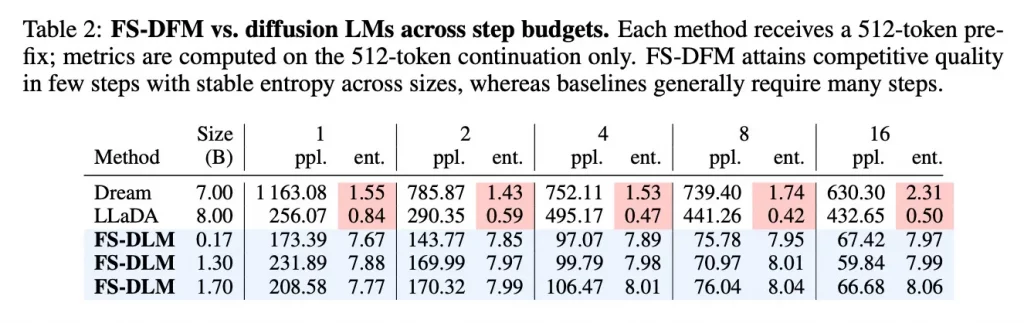

مطالعه تازه اپل با گفتن «FS-DFM: Fast and Accurate Long Text Generation with Few-Step Diffusion Language Models» یک مدل تازه موسوم به Few-Step Discrete Flow-Matching (FS-DFM) معارفه میکند. این مدل میتواند متنهای بلند را تنها با هشت مرحله اصلاح با سرعتی بسیاری تشکیل کند، درحالیکه مدلهای Diffusion معمولی بیشتر از هزار مرحله نیاز داشتند تا کیفیت شبیه اراعه دهند.

برای رسیدن به این شدت، پژوهشگران از سه مرحله منفعت گیری کردهاند: ابتدا مدل آموزش میبیند که چندین مرحله اصلاح متن را مدیریت کند، سپس یک مدل «معلم» برای انجام بهروزرسانیهای دقیق و بزرگتر در هر مرحله به کار گرفته میبشود و در نهایت نحوه اجرای هر مرحله بهینه میبشود تا مدل بتواند با طی مرحله های کمتر و ارامش زیاد تر به نتیجه برسد.

در قیاس با مدلهای بزرگ شبیه، FS-DFM در معیارهای «آنتروپی» و «سردرگمی» کارکرد قابل توجهی داشته است. سردرگمی کیفیت متن را اندازه میگیرد؛ هرچه پایینتر باشد، متن طبیعیتر و دقیقتر است. آنتروپی مقدار مطمعن مدل در انتخاب هر کلمه را مشخص می کند؛ مقدار پایین متن را تکراری یا قابل پیشبینی میکند و مقدار زیاد علتمیبشود متن نامنسجم یا اتفاقی بشود.

مدل FS-DFM با پارامترهای ۱.۷، ۱.۳ و ۰.۱۷ میلیارد، در قیاس با مدلهای Dream و LLaDA با ۷ و ۸ میلیارد پارامتر، در معیار سردرگمی عددی پایینتر و در آنتروپی نتیجهای پایدارتر بهدست آورد.

باتوجهبه کارکرد عالی و افتمدلهای شبیه، پژوهشگران اظهار کردهاند که تصمیم دارند کد و چکپوینتهای مدل را انتشار کنند تا امکان بازتولید و تحقیقات زیاد تر فراهم بشود. مطالعه کامل مقاله در arXiv شامل مثالهای عملکردی و نمودارهایی است که مرحله های اصلاح هر توکن و نحوه تغییرات آن را مشخص می کند.

دسته بندی مطالب

[ad_2]